Quanto consuma in un giorno un’AI?

L’intelligenza artificiale (AI) sta trasformando ogni aspetto della nostra vita quotidiana, dalle auto a guida autonoma alle diagnosi mediche, fino agli assistenti virtuali come ChatGPT e Bard. La crescente attenzione al tema del consumo di energia ha però portato a chiedersi quanto sia il vero consumo in termini di risorse.

Questo argomento è spesso trascurato, ma diventa sempre più importante in un’epoca in cui la sostenibilità energetica è prioritaria. In questo articolo esploriamo in dettaglio il consumo energetico dell’AI, dai singoli prompt fino all’impatto complessivo del settore.

Quante AI esistono attualmente?

L’intelligenza artificiale sta vivendo una crescita esplosiva, con innumerevoli applicazioni in costante evoluzione. Sebbene non ci siano dati precisi sul numero totale di AI attive, sappiamo che colossi come OpenAI, Google e Microsoft gestiscono infrastrutture massicce per servizi come ChatGPT, Bard e Bing AI. Questi sistemi elaborano miliardi di richieste ogni giorno, rendendo l’AI una presenza sempre più pervasiva nella nostra vita.

Dove si trovano i server dell’AI?

Le server farm che alimentano l’AI si trovano principalmente negli Stati Uniti, in Europa e in Cina, ospitate da aziende come Amazon Web Services (AWS), Microsoft Azure e Google Cloud. Questi data center richiedono enormi quantità di energia per funzionare, sia per alimentare i server che per i sofisticati sistemi di raffreddamento necessari a mantenere le macchine operative.

Ad esempio, i data center di Google, noti per la loro efficienza, sono stati progettati per ridurre al minimo il consumo energetico. Tuttavia, l’impatto rimane significativo.

Quanta energia consuma un singolo prompt?

Ogni volta che inviamo un prompt a un sistema come ChatGPT, consumiamo energia. Secondo alcune stime:

- un singolo prompt può richiedere tra 0.01 e 0.1 kWh, a seconda della complessità del modello e del tipo di hardware utilizzato;

- per fare un confronto, streaming un’ora di Netflix consuma circa 0.8 kWh.

Anche se il consumo di un prompt individuale sembra minimo, il volume di richieste – miliardi ogni giorno – genera un impatto energetico considerevole.

Quanta energia consuma un modello di AI in un giorno?

Un grande modello di intelligenza artificiale, come GPT-3 o GPT-4, può consumare quantità di energia impressionanti. Ecco alcuni dati significativi:

- GPT-3, ad esempio, richiede circa 1287 MWh al giorno per funzionare, una quantità sufficiente ad alimentare centinaia di case;

- l’addestramento iniziale di GPT-3 ha consumato circa 1.300 MWh, equivalente al consumo annuo di 130 abitazioni americane.

Questi numeri sottolineano l’importanza di sviluppare soluzioni più sostenibili per il futuro dell’AI.

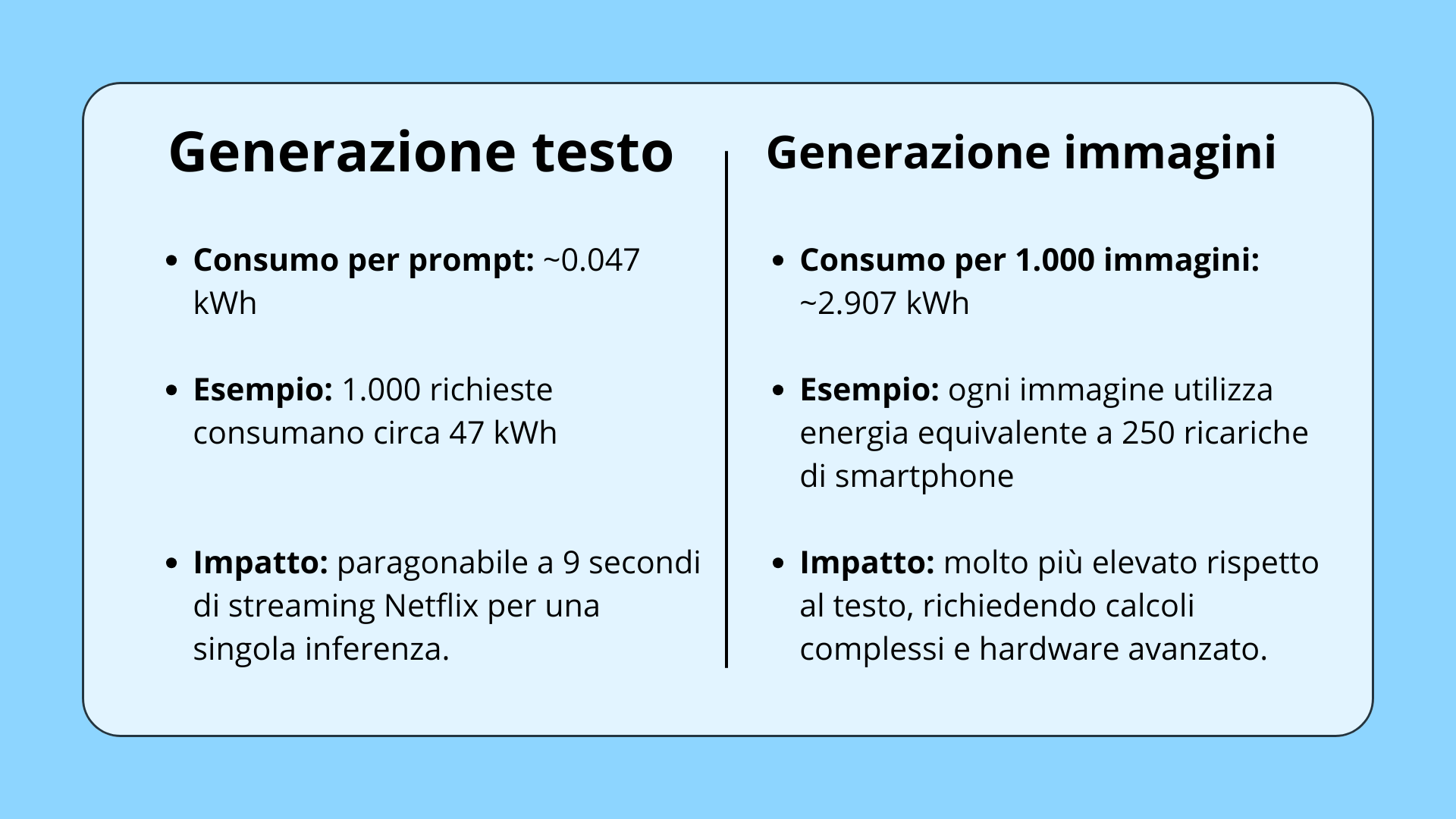

AI e generazione di immagini: ancora più energia

La generazione di immagini tramite AI è ancora più energivora rispetto alla generazione di testo. Secondo uno studio della ricercatrice Sasha Luccioni di Hugging Face:

- generare 1.000 immagini con l’AI consuma in media 2.907 kWh, pari all’energia necessaria per ricaricare uno smartphone quasi 250.000 volte;

- per confronto, la generazione di testo consuma circa 0.047 kWh per prompt, un valore significativamente inferiore.

Questi dati evidenziano la necessità di ottimizzare i modelli per ridurre il loro impatto energetico.

Quanto consuma complessivamente il settore dell’AI?

Secondo alcune stime:

- entro il 2027, l’intero settore dell’intelligenza artificiale potrebbe consumare tra 85 e 134 terawattora (TWh) all’anno;

- questo è comparabile al consumo energetico annuale di paesi come la Svezia o la Germania.

Un fattore trainante di questo consumo è l’hardware specializzato, come i chip NVIDIA utilizzati per addestrare e far funzionare i modelli di AI. Inoltre, i data center globali, che includono infrastrutture per AI e criptovalute, potrebbero arrivare a consumare tra 620 e 1.050 TWh entro il 2026.

Soluzioni per ridurre il consumo energetico dell’AI

Nonostante questi numeri preoccupanti, ci sono diverse strategie in fase di sviluppo per mitigare l’impatto energetico dell’AI:

- efficienza dei data center: l’adozione di tecnologie di raffreddamento innovative e l’utilizzo di fonti di energia rinnovabile come il solare e l’eolico stanno riducendo l’impronta di carbonio dei data center;

- modelli di AI più snelli: i nuovi modelli di AI sono progettati per essere meno energivori, ottimizzando gli algoritmi e riducendo la complessità computazionale;

- dislocazione strategica dei server: spostare i data center in regioni ricche di energia rinnovabile, come Islanda o Svezia, potrebbe rappresentare una soluzione a lungo termine;

- intelligenza artificiale circolare: alcune aziende stanno esplorando il riutilizzo dell’hardware per ridurre gli sprechi e abbattere i costi energetici.

Domande frequenti (FAQ)

1. Quanto consuma un prompt su ChatGPT?

In media, un prompt può consumare tra 0.01 e 0.1 kWh, a seconda del modello e dell’hardware utilizzato.

2. Perché la generazione di immagini consuma più energia del testo?

Generare immagini richiede calcoli più complessi rispetto alla generazione di testo, il che aumenta significativamente il consumo energetico.

3. Come possiamo ridurre l’impatto ambientale dell’AI?

Attraverso data center più efficienti, modelli di AI ottimizzati e l’utilizzo di energia rinnovabile.